Iconada.tv 愛墾 網

文化有根 創意是伴 Bridging Creativity

Comment

-

Comment by Suyuu on May 8, 2024 at 11:36am

-

(續上)評議人李雅琪針對《全沉浸末日腳本》的書寫面向展開探討,並結合其中的四首詩歌文本作具體分析。她指出,在《全沉浸》與《永生是什麼》中,作者對「永生」做出「永生即是死亡」的解構,這是一種對於人類最終走向的思辨與探討。人的形態變得虛無而多變,人的主體性從而需要重新定義。在末日背景下,「人」的概念、尊嚴、主體性被消解與重塑。《德洛麗絲的夢》與《雪豹的故鄉》兩首作品則將詩歌從那些討論理性、政治、文明的傳統文學文本拉到一個面向未來的科幻文本范疇中,從而為詩歌面向未來、想像以及更廣闊的人類命運提供了一種嘗試的路徑。

發言人馬俠以「在技術加速時代中捕捉一個有情的世界」為題分析小說《後來的人類》。她指出,電子產品承載著每個人大量的知識和記憶,如今的我們很難離開手機,與其說它是一個機器,不如說它是我們的器官,也是科幻作品中所謂的「義肢」。而在這個加速內爆的時代,我們的感知能力、生活體驗早已發生了翻天覆地的變化,寫作和文學也應當走進時代、觸及人類最柔軟和最堅硬的部分。《後來的人類》講述的是技術時代最普通的人類日常,不僅寫未來社會的後人類,還寫那些被技術拋下落後於時代的人,當進化或異化的颶風吹進普通人的生活中時,他們從被遺棄和摧毀的廢墟找回殘存的人類之心,喚醒勇氣、疼痛、智慧、愛,再造生機。《後來的人類》不僅可以為我們書寫信息時代中的情感和網絡時代人們獨特的生活體驗提供范例,更能啟發我們對於在虛擬與真實混溶的時代該如何生活產生進一步思考。

評議人陳勇彬針對《後來的人類》的寫作面向與風格展開探討。他指出,作者糖匪的小說筆法既具有以展現世情為追求的現實主義色彩,又呈現出科幻文學天馬行空的幻想風格,可謂是一種從科幻文學走向現實主義文學的「現實主義化科幻文學」。科幻小說往往是在突出某種現實問題,並將其放置於想像中的未來世界。可實際上,這些看似科幻的內容的本質與當下生活是同構的,科幻小說所運用的手法正是將這些表面微小的時代、生活細節無限放大。糖匪的《後來的人類》正是利用這種手法營造出陌生化效果,使我們從常規的認知中跳脫而出,也以此拓展了科幻小說的思想內涵。

發言人施岳宏以「新媒體時代下的世情書寫」為題分析張怡微短篇小說集《四合如意》。他認為,新媒體時代下,互聯網與各種社交媒體的高速發展不僅為人類生活帶來顯著的科技便利,在技術爆炸的倒影中,都市人的日常生活、情感體驗、交流方式也正向新的形態轉變。《四合如意》聚焦平凡人生活日常中的細微、瑣碎之處,注重呈現當下都市人的生活經驗與心理感受。小說內數篇故事的落腳點是新媒體世代日常中「反傳奇」的生活細節,也是不同都市人共同偏向疏離、焦慮、迷惘的精神狀態。「情隨世變,事事如新」,該作品關注都市人在與各種新技術相處中的適應與不適,一定程度上延展了世情小說的書寫范疇。進一步而言,作為加速內爆時代中的寫作者,能如何書寫不斷劇變中的生活經驗與精神情感?《四合如意》或許能為人們開拓更豐富的視野。

評議人鄭沁辰針對書中人物的生活經驗和精神情感展開探討,她認為《四合如意》的書寫很精准地建構、處理了一種矛盾和融洽相統一的狀態,即是當手機以機器的物質形態佔據了人們的精神空間時,人們會對著手機來履行新的社會和情感責任,並在虛擬空間型塑另一個願意被他人看到的自我形象的生存情境。而在情感處理方面,作者利用各種媒介背後的虛擬社交方式建構想像,將其有意佈置在描寫人物內心「情感處理」發生的上下文之間,使得這些想像產生足以引人深思的文學氣韻。

(原題:趙天琥「加速內爆時代:電子信息技術對寫作者的延伸、遮蔽和取代」閱讀激發工坊,2023年5月26日8:30到11:30,在上海大學中國創意寫作研究院文學院308學術研討室順利舉行,工坊由許道軍老師指導,由陳勇彬同學主持。)

-

Comment by Suyuu on May 4, 2024 at 2:29pm

-

翟永明詩歌·一個無邊的路由器一個無邊的路由器

悄無聲息 佔領了我們的身體

像植物曾經佔領地球

像動物曾經佔領世界

我們會成為遠古物種嗎?

基因系列 管理我們的身體但毛髮、皮膚 拜父母所賜

我們的大腦將與宇宙連線

我們的存在 退為一種模式

深邃或原始 當浩瀚抵達

我們像星群一樣閃耀

像日月一樣高掛

但我已遠離塵世 成為幽靈人生沒有倒檔

只有倒敘

-

Comment by Suyuu on May 3, 2024 at 9:57am

-

“愛墾”自許:把根釘子敲深一點近來咳嗽,生產力不高,上《愛墾》也看不下大篇文章,倒發現Host Studio的圖與文,很適合我的胃口。去他的頁面去看,再看看我自己的,發現我們其實都是不愛長篇大論的人,卻很愿意把自己的一些短小想法造句出來,借好的攝影給予表達。

再三看看我們自身的頁面,和現在中國大陸近月流行起來的“新浪輕博”、“點點微博”對比,老天,其實是很相像的東西。重點是,我發現以馬來西亞為基地的“愛墾”,早在兩年多前就開始推出這樣的格式。而中國大陸現在才開始玩這東西。

他們人多勢眾,可以一口氣就發一千數百張照片,可是絕大部分少了比較用心撰寫的文字,沒有做第二次創作。有點像地攤。

無所謂啦,比較也無謂,還是努力的把這個微薄、輕博的格式,好好聚焦在文化中華創意產業上,我知道這是“愛墾”的自許,老編應該把這根釘子敲深一點。(Comment by iki kia kiak on September 29, 2011 at 9:35am)

-

Comment by Suyuu on April 11, 2024 at 4:25pm

-

邱誌勇·記憶的藝術性想像,以及數位性轉化

當代數位科技已扮演猶如社會中樞神經系統的角色,「數位轉向」(digital turn)似乎也已是不爭的事實,且打造此般的數位天地,促使許多人深信「機器優於人類」的命題。貝爾納.斯蒂格勒(Bernard Stiegler)在《人類紀裡的藝術》指出,這種始於1993年數位轉向的科技震撼中,透過網路科技的全球開放網絡,超工業化的系統透過遠程──行動的網路,對遠程的對象進行控制,致使整體社會運作體系轉化成人們所熟悉的數位經濟。隨著數位時代的全面到來(包含大數據、機器學習、人工智能、物聯網等新科技的普及),大規模「數位化」世界圖景的景致既是歷史性的,也是增補性的當代生存樣態,整體且普遍的人工智能化而引發一系列社會文化、地緣政治、生存環境、生命倫理等人類生活世界的改變。甚至,人們生活經驗藉由技術所構成的景況已不言而喻。如同唐.伊德(Don Ihde)在《科技與生活世界》所述,科技技術以物質文明中各種人工物的形式存在於我們的環境之中,且深深地影響人們的行動、知覺與理解方式,然而,當「數位無所不在」,人類社會卻悄悄地進入所謂的「後數位情境」(Post Digital Condition)。羅素.戴維斯(Russell Davies)便曾言,後數位應該是下一個激動人心的階段,它不是舊秩序的回歸,而是人們開始「在屏幕之外進入世界的地方」(in the world beyond the screen)。梅爾.阿利森貝格(Mel Alexenberg)在《後數位時代的藝術未來》一書中清楚地定義所謂的「後數位」(post-digital),指涉的是一個在人類與數位科技間關係快速變遷下的藝術創作,以及藝術如何更關切人類的生存實際景況,而非數位科技本身。

王新仁 明日的路徑 2019 演算音像 尺寸依場地而定(圖版提供:王新仁)

那麼,是什麼樣的「新人類景況」值得藝術家透過創作實踐的策略來彰顯呢?貝爾納.斯蒂格勒將環境科學研究中所提呈的「人類紀」概念,轉化到人文社會的當代哲思中,開啟關於人類生存樣態的討論。在巨量資訊的運作邏輯將一切量化、測定、校準,以便讓後數位的人類世界更加標準化之際,人類已經與其環境一樣,都被轉換成資料,且能被資訊設備簡化成可測定的、可更新修改的數量。

無所不在的巨量資訊運算公司根據從每個人身上蒐集到的「數位足跡」,直截了當地造成了數位個體。而根據馬克.莒甘(Marc Dugain)與克里斯多夫.拉貝(Christophe Labbé)的《裸人》一書,這種巨量資訊公司所抱持的自由意志主義,更不計一切代價爭取科技進步。從人機、跨物種系的混雜,從「以人類為中心」的思維(即人類被其他物種所取代的人文主義),轉向「人類其實早已是科技主體的賽博格」思維,在這個轉向的過程裡,是賽博格自身的演化史,它涵蓋所有知識領域,從生物學、地質學、資訊學、神經醫學、文化、藝術領域……,疊合積累成「人類紀」(anthropocene)。本文以筆者於國立台灣美術館策畫「後數位人類紀:國際科技藝術展」中受邀之藝術作品為例,說明本文命題「記憶的藝術性想像,以及數位性轉化」,此一命題主要在於彰顯藝術家如何運用實體物質與虛擬真實景觀圖象,共同展現日常生活物件重新轉化與再組裝配置的記憶圖象。王新仁的〈明日的路徑〉以3D實景掃描與波函數塌縮演算法表意台灣原生地貌在每一次觀看過程中,都能產生似真若假,也別於現實的新組成。王新仁藉由資訊演算形塑而成的數位空間可謂是一個動態的世界,軟體程式可能為使用者開創了些許特別的領域與經驗範疇。(見《藝術家》2019年4月527期)

-

Comment by Suyuu on February 19, 2024 at 8:06am

-

Malaysian digital firms rake in RM767 mil in exports

KUALA LUMPUR: Local companies in the digital technology industry have generated RM767 million of export value to Malaysia's economy, said communications and Digital Minister Fahmi Fadzil.Fahmi said in the startup arena, companies like Aerodyne and Meraque are gaining international recognition.

"Aerodyne is ranked number one by Drone Industry Insights in its 'Drone Service Provider Ranking 2021 and 2022', while another drone company, Meraque, ranks among the top 20 in the world.

"I am proud to announce that our local companies have generated RM767 million worth of export value," he said at Malaysia Digital Expo (MDX) 2023 Grand Finale.

Meanwhile, Fahmi said Malaysia's gaming market and animation industry is thriving with local studios making a global impact.

He said to date, local animation studios have produced more than 65 original pieces of intellectual property, creating over US$40.5 million in export value while at the same time expanding their presence to more than 120 countries.

"Over RM1 billion in annual export value has been generated through over 100 Malaysian gaming studios," he said.

Malaysia Digital Economy Corporation (MDEC) chief executive officer Mahadhir Aziz said the corporation is setting a new direction for Malaysia's digital ecosystem, focusing on self-reliance and innovation while reducing dependency on grants.

Mahadhir underlined the necessity of moving away from what he referred to as the 'grantrepreneur' mindset, where businesses solely rely on grants without taking proactive steps to innovate and address market needs.

"We have been trying so hard to move away from the mindset that we call 'grantrepreneur.' People will just wait for something like this, without doing anything."

"Look at the success of local businesses like Aerodyne and carsome, what is common among those companies, they were never initial beneficiaries of any Malaysian grant," he said.

However, Mahadhir said while MDEC is committed to nurturing self-sufficiency, the organisation will continue to focus on grants for specific purposes.

These grants will be directed towards initiatives that create new intellectual property and foster competition in the digital creative content space, he added.

The MDX 2023 Grand Finale marks the culmination of a six-week empowerment journey through 18 auxiliary events that commenced on September 25, 2023. MDX 2023 has garnered significant attention, with a total of 120,000 participants engaging in the event.

Over the course of three days, industry experts will share their insights through a series of conferences and networking sessions.

The MDX 2023 Grand Finale will also include an exhibition and an exclusive MDX 2023 Awards Night to celebrate the outstanding innovations and achievements within the local digital technology ecosystem.

(Source: NST, Malaysian digital firms rake in RM767 mil in exports- Fahmi Fadzil By Azanis Shahila Aman and Aliza Shah - November 6, 2023)

-

Comment by Suyuu on February 13, 2024 at 10:11am

-

How Do I Find Someone to Write My Life Story? by Harvey Beck

People hire writers to help write their memoir for lots of different reasons.

Perhaps you’re struggling to decide what’s important to include. Maybe some things are simply too difficult emotionally to write about yourself. Perhaps you’ve started a memoir but can’t make headway. Maybe you simply can’t decide where to begin.

Hiring a professional writer means that someone skilled will organize your stories into a cohesive, compelling read in as little as a few months.

Together, you and your writer will turn your life story into a memoir that will be in your voice and have your message. Though someone else’s hands may have typed the words, those words (and that book) will be yours in every other way.

-

Comment by Suyuu on February 13, 2024 at 10:11am

-

Before you read ahead, check out Memoirs App fromLifeTales. The best app for writing your memoir online.

How Do I Find a Ghostwriter?

“Ghostwriter” is a term for any writer hired to help you write your story in your own voice.

A simple Google search will turn up any number of reputable writing companies that specialize in memoir and biography (remember—there is a difference!)

Make sure you do your research: some companies are a single individual; others are larger companies with best-sellers under their belts. Either way, know the difference and be sure to ask for samples and references. Make sure you’re happy with the writer before signing a contract.

The Writing Contract

writing a memoir contract with a ghostwriterAny reputable ghostwriter or writing firm will have a standard contract that lays out the expectations and obligations of each party to one another. Make sure you read and understand the contract and that you’re in agreement, as it is a legally binding agreement. This is a serious investment of time and money you are making, so it couldn’t hurt to have a lawyer look it over if you are unclear about any of the clauses or terminology. If anything is unclear or makes you uncomfortable ask for clarification or negotiate to reword the contract.

How Much Will It Cost to Hire a Writer for My Life Story?The short answer is: it depends.

You can find writers who are inexpensive (but probably not as experienced) and writers who have years of experience and even New York Times-bestselling books (but who will cost a lot more to hire). And, as is often the case, you get what you pay for.

-

Comment by Suyuu on February 12, 2024 at 1:24pm

-

For a typical memoir, expect to spend at least thousands of dollars ($7500 to $10,000 on the low end) to tens of thousands of dollars (professional ghostwriters with a serious track record can easily command anywhere from $25,000 to $50,000+ per project).

Payment Schedule for Writing Work

payment schedule for writerYou should work out payment in installments, and these should be spelled out in your contact with the writer.

You could pay in thirds (one third on signing, one third on a complete first draft, one third on revised final draft). Or you can pay in quarters or any other breakdown that’s mutually agreeable.Any request for payment in full upfront should be a red flag, and you should not pay. Walk away from anyone making such demands as it is unprofessional and you might get scammed.

How Long Will It Take to Write My Memoir?From start to finish, expect the process to take between six and twelve months. This includes time for all interviews, research, drafting, and revision. Other factors, unexpected delays, or requests for changes midway through may extend this range.

If you want a manuscript complete in a short timeframe, it may be possible depending on the writer but expect to pay a premium for an accelerated schedule.

What Will Ghostwriting Involve?1) Interviews and research to get to know you and your story

This could be handled remotely via Skype or telephone, or it may involve travel by the writer to visit you and your family to conduct interviews. You should expect hours or even days of interviews, depending on the scope and scale of the project.

2) Planning and outlining your book

With reviews in hand, the writer will begin to work up a plan and outline for your book. They will likely run this outline by you for your approval and input before they start work

3) Ghostwriting the content

Just like it sounds. This is where the bulk of the writing will occur, based on the interviews and outline.

4) Revisions based on your feedback and guidance

You will have an opportunity to read and review the draft, either in stages or once completed. At that point, you should make a detailed list of changes or corrections you’d like the ghostwriter to make. If you don’t want any, that’s great! But if you do, your writer should revise the work until you are satisfied with the product.

5) Editing to eliminate spelling and grammar errors

Editing (also called copyediting) is usually the last stage. Once the writing and revisions are complete, the writer will go through the work to ensure it is as error-free as possible.

Who Owns the Rights to the Work?As a work-for-hire project, the contract you sign with the writer should spell out that you—the person who commissioned the work—will have all rights to the work, including copyright. The contract should also say that you’re free to pursue use of the material in whatever way you want with no further compensation due to the writer.

We hope this post helps you hire the right person to write your life story or memoir. If you want to start writing your memoir yourself, try the Memoirs App from LifeTale for free. (https://www.lifetales.com)

-

Comment by Suyuu on January 20, 2024 at 12:19am

-

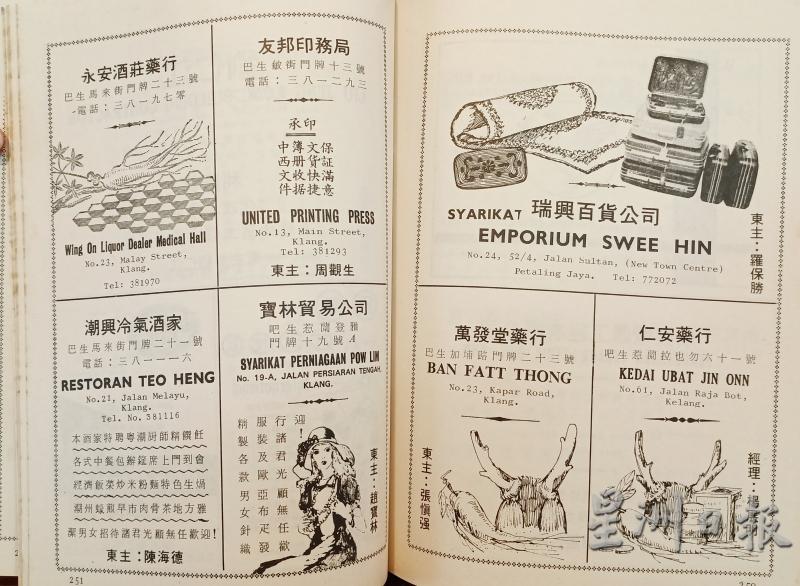

誕生于特刊广告的地方誌

(巴生訊)刊登在報紙和會刊的商業廣告,一般人都是「過目即忘」,但對撰寫地方志的文史工作者而言,早期的這類商業廣告,才是打開和探索一個時代的鑰匙,從而挖掘出一座城市在開埠和發展時,華人社會及華商扮演的重要角色。

負責編撰《巴生歷史之旅專輯》,該書甫於今年1月付梓的劉崇漢接受《大都會》社區報記者專訪時指出,商業廣告一般有商號業務和地址,從中可搜羅出一座城市在某個年代蓬勃的行業發展。

「巴生是個工廠多和工人多的城鎮,這些華人實業家的出現,促進和活絡和地方經濟,提高就業機會和貨物銷路,是可貴的地方史料檔案。」

這類商業廣告對一般人都是「過目即忘」,但成了劉崇漢探索早期華人實業家的珍貴史料。

「例如巴生早期有許多橡膠園,誕生了馮強樹膠制造廠及鞋廠,並一度在百貨公司設立專櫃售賣,業務非常火紅、以及應巴生港口而生的許多貨運及物流公司。」

-

Comment by Suyuu on January 20, 2024 at 12:19am

-

珍貴史料 了解地方經濟

劉崇漢認為,這些珍貴的華族和華商創業史料,有助了解地方上的經濟特色,進而重塑一座城市的無形資產價值。

他透露,早期學校的畢業特刊,畢業生都需要去找商家征求刊登廣告,因此從這些許多人收藏在家視為「收之無用,棄之可惜」的特刊,對他可是開啟時代寶藏的一把鑰匙,足以發掘出巴生的許多老字號。

他舉例,在一篇「緬懷公司創辦人岑業良逝世41周年紀念」的挽詞中,落款處除了有巴生人熟悉的岑業良膠廠,還有「金山茶園公司」,讓他了解到原來岑家在金馬侖高原還坐擁一家茶業公司,顯見巴生華商活躍於全馬各地且業務多元化。

盼更了解傳奇女商池龍

也是大馬華人文化協會副會長的兼雪州分會會務顧問的劉崇漢形容,《巴生歷史之旅專輯》是了解巴生的一個入門,一些在地居民的集體記憶都可在書內找到,堪稱是一本值得巴生人擁有和收藏的地方志。

許多上一輩收藏在家,今人視為「收之無用,棄之可惜」的舊會刊和舊廣告,在劉崇漢眼中,是開啟時代記憶的一座寶庫。

愛墾網 是文化創意人的窩;自2009年7月以來,一直在挺文化創意人和他們的創作、珍藏。As home to the cultural creative community, iconada.tv supports creators since July, 2009.

Latest Activity

Videos

-

鬼王大士爷

Added by engelbert@angku张文杰 0 Comments 84 Promotions

Blog Posts

陳明發:文創的文化要素

Posted by 馬來西亞微電影實驗室 Micro Movie Lab on February 21, 2021 at 11:00pm 7 Comments 71 Promotions

《愛懇網》17週年(2009-2026)誠意禮贈

Posted by 馬來西亞微電影實驗室 Micro Movie Lab on February 18, 2021 at 5:30pm 18 Comments 79 Promotions

柳敬亭說書

Posted by Host Studio on May 14, 2017 at 4:30pm 11 Comments 55 Promotions

Good and Fond Memories - Dedicated to all those born in 1940's, 1950's & 1960's

Posted by 用心涼Coooool on July 7, 2012 at 6:30pm 39 Comments 59 Promotions

愛墾雲端藝廊: 戀戀·文物館

Posted by 就是冷門 on August 24, 2013 at 10:00pm 87 Comments 86 Promotions

愛墾網特寫·新冠肺炎:人文景觀

Posted by 罗刹蜃楼 on April 6, 2020 at 11:30pm 40 Comments 69 Promotions

陳明發《2019新冠肺炎 觀察紀事》

Posted by 葉子正绿 on April 2, 2020 at 5:00pm 77 Comments 75 Promotions

《愛墾雲端藝廊》~~味蕾主題館

Posted by Rajang 左岸 on August 26, 2013 at 8:30am 29 Comments 67 Promotions

社會企業的定義

Posted by 來自沙巴的沙邦 on November 4, 2015 at 7:30pm 3 Comments 83 Promotions

Creative Industries Policy in Malaysia

Posted by Dokusō-tekina aidea on January 5, 2016 at 9:00pm 35 Comments 79 Promotions

© 2026 Created by 馬來西亞微電影實驗室 Micro Movie Lab.

Powered by

![]()

You need to be a member of Iconada.tv 愛墾 網 to add comments!

Join Iconada.tv 愛墾 網